L’IA transforme la nature du contentieux : ce que les avocats doivent comprendre

Pendant longtemps, le débat sur l’intelligence artificielle dans les cabinets d’avocats s’est concentré sur un seul angle : la productivité. Recherche documentaire plus rapide, rédaction d’actes assistée, analyse contractuelle automatisée. Des gains réels, indéniables, mais qui masquent une transformation plus profonde en cours.

Ce qui change aujourd’hui, ce n’est pas seulement la façon dont les avocats travaillent. C’est la nature même du contentieux qui évolue. L’IA permet désormais de produire des requêtes en masse, de générer des argumentaires à la demande et d’automatiser des démarches juridiques qui nécessitaient hier l’intervention d’un professionnel. Résultat : les tribunaux font face à un volume croissant de dossiers, dont la qualité juridique est inégale.

Pour les avocats, cette évolution crée un nouveau type de défi : comment défendre efficacement dans un système judiciaire où les contenus générés par IA se multiplient, avec tout ce que cela implique en termes d’erreurs, de temps perdu et de responsabilité ?

📌 À retenir : L’IA ne transforme pas seulement les outils des avocats — elle transforme la structure même du contentieux : volume, qualité, responsabilité. Trois dimensions que les professionnels du droit doivent appréhender ensemble.

1. L’émergence d’un contentieux de masse assisté par IA

L’intelligence artificielle a franchi un seuil. Elle ne se contente plus d’assister les professionnels du droit dans leurs recherches : elle est désormais capable d’exécuter des tâches qui relevaient jusqu’ici du travail de l’avocat. Analyse de documents, révision de contrats, prédiction de résultats, formulation de conseils juridiques — les outils basés sur le traitement du langage naturel (NLP) et l’apprentissage automatique peuvent produire des documents juridiques de manière autonome.

Cette capacité a un effet direct sur l’accès au droit. Des justiciables qui n’auraient pas engagé de procédure faute de moyens ou de connaissances peuvent aujourd’hui générer une mise en demeure, rédiger une requête ou construire un argumentaire avec l’aide d’un assistant juridique intelligent. C’est une évolution positive sur le principe — l’accès au droit est une valeur que la profession défend. Mais elle s’accompagne d’une réalité moins confortable.

Lorsque la production de documents juridiques devient accessible à tous, sans filtre ni formation, le volume de litiges augmente mécaniquement. Les tribunaux reçoivent davantage de requêtes, davantage de conclusions, davantage de pièces. Et dans cet afflux, la qualité n’est pas uniforme.

L’IA peut automatiser l’élaboration de clauses standards, analyser rapidement des documents et fournir des avis juridiques de premier niveau. Ce qui était une barrière à l’entrée — le coût et la complexité du droit — devient progressivement une simple étape technique.

2. La dégradation de la qualité juridique des contenus générés

L’augmentation du volume ne s’accompagne pas d’une amélioration de la qualité. C’est là le problème central que les avocats commencent à rencontrer dans leur pratique quotidienne.

Hallucinations et erreurs : deux phénomènes distincts

Pour travailler efficacement avec ces nouveaux contenus, il faut d’abord distinguer deux types de défaillances des outils d’IA générative.

⚠️ L’hallucination est un phénomène propre aux modèles de langage. L’IA invente des réponses qui semblent plausibles mais sont factuellement fausses. Elle peut ainsi citer un arrêt de la Cour de cassation avec une référence précise, une date, un numéro de pourvoi — et cet arrêt n’existe tout simplement pas. Ce n’est pas une erreur de raisonnement : c’est une conséquence structurelle de la façon dont ces modèles fonctionnent. Ils privilégient la cohérence textuelle sur la vérité factuelle.

L’erreur, en revanche, ressemble davantage à une erreur humaine : une mauvaise interprétation d’un texte, une qualification juridique inexacte, une confusion entre deux régimes. Tous les systèmes d’IA peuvent en commettre, y compris ceux qui ne sont pas génératifs.

Confondre ces deux phénomènes conduit à appliquer de mauvaises solutions. Pour limiter les hallucinations, il faut restreindre le champ d’action de l’IA, exiger des sources vérifiables et la connecter à des bases de données fiables. Pour réduire les erreurs, il faut travailler la qualité des données et des instructions transmises à l’outil.

Des arguments non pertinents qui encombrent les débats

Au-delà des erreurs factuelles, les contenus générés par IA présentent souvent un autre défaut : ils manquent de pertinence stratégique. Un modèle de langage peut produire un argumentaire juridiquement cohérent en apparence, mais inadapté au contexte précis du litige, à la juridiction saisie, ou à la jurisprudence locale applicable. Ces arguments non pertinents alourdissent les échanges, allongent les procédures et obligent les avocats adverses — comme les juges — à consacrer du temps à démêler le pertinent de l’accessoire.

3. L’impact sur les juridictions

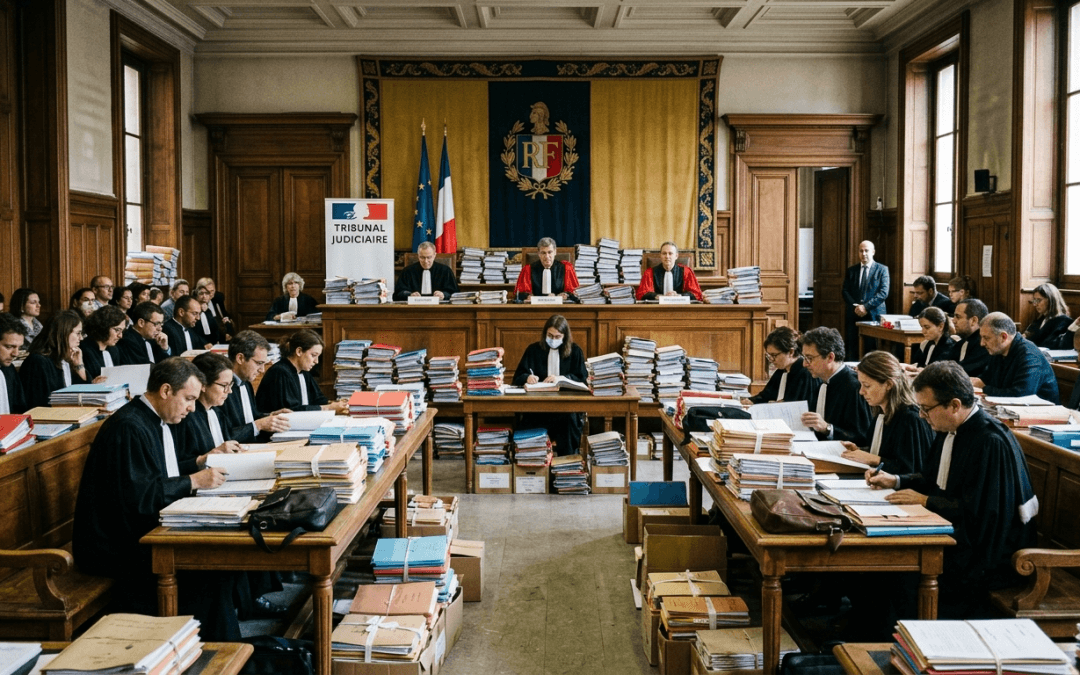

Les tribunaux subissent depuis plusieurs années une pression sur leurs délais de traitement. L’afflux de dossiers liés à l’utilisation de l’IA par des justiciables non assistés, ou mal assistés, vient s’ajouter à une situation déjà tendue.

Un engorgement accentué

Lorsque l’IA facilite la production de requêtes, elle abaisse le seuil à partir duquel un justiciable décide d’engager une procédure. Des litiges qui n’auraient pas été portés devant un tribunal — parce que le coût ou la complexité était dissuasif — arrivent désormais en audience. Certains sont fondés. D’autres reposent sur des arguments générés automatiquement, sans analyse réelle de la situation.

Les juridictions doivent alors traiter un volume plus important, avec des ressources qui n’ont pas augmenté dans les mêmes proportions. Les délais s’allongent, et les dossiers sérieux se retrouvent noyés dans un flux plus dense.

Un filtrage accru en amont

Face à cette réalité, les juridictions développent des mécanismes de filtrage plus stricts. Les exigences formelles sont davantage contrôlées. Les irrecevabilités sont prononcées plus rapidement. Les juges, comme les greffes, sont amenés à identifier plus tôt les dossiers qui ne répondent pas aux conditions de recevabilité — ce qui suppose un travail supplémentaire en amont pour les avocats qui veulent que leurs requêtes passent ce filtre.

4. Les nouveaux risques pour les avocats

Pour les avocats, cette transformation crée des risques concrets qui méritent d’être identifiés clairement.

Traiter des dossiers « pollués »

Un avocat peut se retrouver à défendre un client dont le dossier a été en partie constitué avec l’aide d’un outil d’IA, sans qu’il en soit informé. Pièces mal qualifiées, chronologie reconstituée avec des inexactitudes, arguments tirés d’une jurisprudence inexistante — autant d’éléments qui obligent l’avocat à reprendre le travail depuis le début, souvent dans des délais contraints.

La situation est symétrique côté adverse : lorsque les conclusions en face reposent sur des arguments générés par IA, il faut les identifier, les analyser et y répondre — même s’ils ne tiennent pas juridiquement. Ignorer un argument, même faible, reste risqué.

La responsabilité sur les contenus IA

L’avocat conserve l’entière responsabilité des actes juridiques qu’il produit, quelle que soit la méthode d’élaboration employée. Utiliser un outil d’IA générative ne transfère pas cette responsabilité à l’éditeur du logiciel. Si une conclusion comporte une référence jurisprudentielle inventée par l’IA, c’est l’avocat qui en répond devant la juridiction — et potentiellement devant son client.

La vérification des résultats produits par l’IA n’est donc pas une option. C’est une obligation professionnelle, au même titre que la vérification d’une citation doctrinale ou d’une date de prescription.

La confidentialité des données clients

L’utilisation d’outils d’IA soulève des questions sérieuses sur la confidentialité. Transmettre des données à un assistant juridique intelligent, les stocker dans le cloud via des infrastructures tierces, introduit des vulnérabilités. Le secret professionnel ne disparaît pas, mais il se déplace vers une hygiène numérique rigoureuse : choix des plateformes, conditions générales d’utilisation, localisation des données, politique de conservation.

La perte de temps stratégique

Paradoxalement, l’IA peut consommer du temps plutôt qu’en faire gagner, lorsqu’elle est mal utilisée. Vérifier des sources inventées, corriger des argumentaires mal construits, reprendre des dossiers partiellement traités par des outils automatisés — ces tâches peuvent mobiliser un temps qui devrait être consacré à la stratégie, à la relation client, à la préparation des audiences.

Les avocats qui s’adaptent le mieux ne sont pas nécessairement ceux qui utilisent le plus l’IA. Ce sont ceux qui comprennent ce qu’elle fait — et ce qu’elle ne fait pas.

5. Les compétences à développer pour s’adapter

Face à cette transformation, les avocats qui s’adaptent le mieux ne sont pas nécessairement ceux qui utilisent le plus l’IA. Ce sont ceux qui comprennent ce qu’elle fait — et ce qu’elle ne fait pas.

Comprendre les capacités et les limites des outils

L’IA excelle dans certaines tâches : recherche de précédents dans de grandes bases documentaires, analyse de volumes importants de pièces, génération de premiers jets à partir d’instructions précises. Elle ne remplace pas le jugement humain, l’analyse contextuelle ou la stratégie juridique. Savoir tracer cette frontière est la première compétence à développer.

Des formations spécialisées permettent d’apprendre à vérifier les résultats produits par ces outils, à identifier les hallucinations, à calibrer leur usage selon les types de tâches.

Maîtriser la formulation des instructions

L’efficacité d’un outil d’IA dépend directement de la qualité des instructions qu’on lui donne — ce que les praticiens appellent le prompt engineering. Un avocat qui sait formuler une demande précise, en définissant le contexte juridique, le type d’analyse attendu, les sources à privilégier et le format souhaité, obtiendra des résultats bien plus exploitables qu’un utilisateur qui pose une question vague.

Renforcer la capacité de tri et de validation

Dans un environnement où les contenus juridiques se multiplient — qu’ils viennent de l’IA ou non — la capacité à trier, hiérarchiser et valider l’information devient une compétence à part entière. Détecter une référence inexistante, identifier un argument hors sujet, repérer une qualification erronée : ces réflexes, qui relevaient autrefois de la formation juridique classique, doivent être renforcés et adaptés aux nouveaux contenus.

Concentrer l’énergie sur la stratégie contentieuse

Si l’IA prend en charge les tâches répétitives, elle libère du temps pour ce que les outils automatisés ne peuvent pas faire : construire une stratégie, anticiper les arguments adverses, préparer un contre-interrogatoire, adapter la posture en audience. Les avocats qui investissent dans ces compétences se différencient dans un marché où la production documentaire est de moins en moins un avantage concurrentiel.

Adopter une pédagogie claire avec les clients

Les clients utilisent eux-mêmes des outils d’IA pour se renseigner sur leurs droits, évaluer leurs chances, préparer leurs questions. Ils arrivent parfois avec des certitudes construites sur des informations partielles ou inexactes. L’avocat doit être en mesure d’expliquer simplement pourquoi un argument généré par IA ne tient pas, sans décrédibiliser le client, et de recadrer les attentes sur des bases solides.

Cette pédagogie s’étend aussi à l’usage de l’IA dans le traitement du dossier : expliquer ce que l’outil fait, ce qu’il ne fait pas, comment les données sont protégées. C’est une question de transparence, mais aussi de confiance.

Respecter le cadre déontologique

Le Barreau de Paris a publié des guides de bonnes pratiques sur l’usage de l’IA. Ces ressources permettent de cadrer l’usage des outils au regard des obligations déontologiques : confidentialité, indépendance, compétence. Documenter l’usage de l’IA dans les dossiers, choisir des plateformes conformes aux exigences de protection des données, informer le client — autant de pratiques qui relèvent désormais de l’exercice professionnel responsable.

Ce que cette transformation change concrètement

L’IA ne remplace pas l’avocat. Mais elle modifie les conditions dans lesquelles il exerce. Le contentieux de demain sera plus dense, plus rapide à initier, et plus inégal en qualité. Les avocats qui s’y préparent aujourd’hui — en comprenant les outils, en renforçant leurs compétences analytiques et stratégiques, en adoptant une hygiène numérique rigoureuse — seront mieux placés pour défendre efficacement leurs clients dans cet environnement.

Ceux qui ignorent cette transformation risquent de se retrouver à gérer des dossiers plus complexes, avec des délais plus courts, face à des juridictions moins tolérantes pour les requêtes mal construites. Ce n’est pas une question de technologie. C’est une question de méthode.

📌 Les bonnes pratiques à adopter dès maintenant :

- Vérifier systématiquement les sources et références produites par tout outil d’IA avant de les intégrer à un acte ou une conclusion.

- Choisir les plateformes d’IA en tenant compte des exigences de confidentialité et de protection des données clients.

- Former les collaborateurs à identifier les hallucinations et à valider les contenus générés automatiquement.

- Informer les clients sur les limites des outils qu’ils utilisent eux-mêmes pour préparer leurs dossiers.

- Consulter les ressources disponibles auprès des barreaux et des institutions professionnelles pour rester à jour sur les bonnes pratiques.